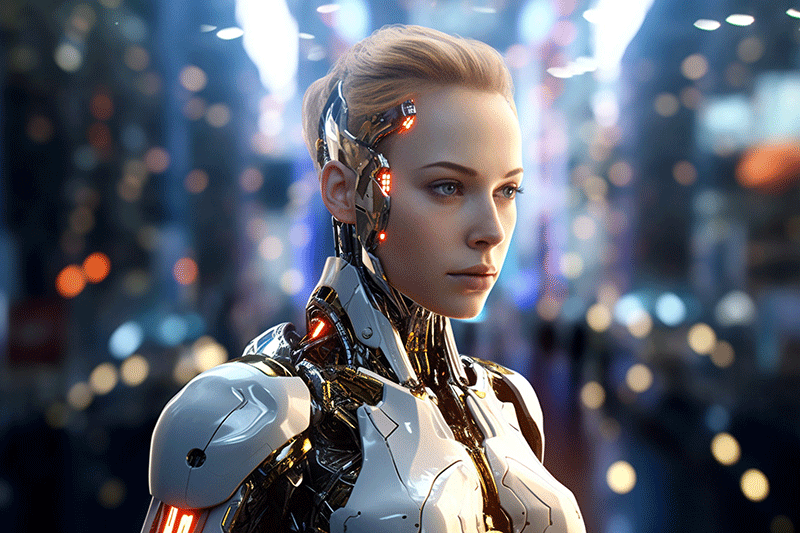

远传科技的“数字主持人”是经由语音合成、唇形合成、表情合成以及深度学习等技术,克隆出具备和真人主播一样播报能力的数字人。经由语音合成技术和视频驱动技术,只需要输入一段文本,它就能在屏幕展现虚拟数字人形象并进行新闻播报,且唇形动作能与播报声音实时同步。

或许在不久的未来,再也分不清视频中的主持人,究竟是真人还是虚拟人,而这一天正在到来。

一、根源探究:「高逼真」的背后

远传科技“数字主持人”以真人为原型,通过将真人形象数字化扫描技术,建立超写实 3D数字人建模,多模态识别及生成、实时面部动作生成及驱动、迁移学习等技术「熔炉」,炼就而成。

从效果上来说,3D AI合成主播给人的最大印象便是高逼真,它较好的还原了真人的发肤、表情;同时,灵活性、可塑性更强,拥有的丰富的面部表情动作,嘴部唇动,以及身体的轻微摆动,具备在更广阔空间使用的潜力。

透过 3D AI合成主播技术实现过程,探究它为何拥有如此逼真的效果。

1.数字化扫描技术还原真人形象

建立人物模型必须要有海量数据,远传科技数字化扫描技术通过摄像头对真人原型的身体各个部位进行全方位「打点」扫描,采集每一处细节,并对其多种形态的面部表情动作,嘴部唇动,以及身体的轻微摆动进行细致入微地捕捉记录,还原真人形象。

2.深度学习算法生成3D数字人模型

远传科技算法工程师熟练应用深度学习算法,对算法里的大量参数进行调优,确保生成的3D数字人模型能够精确的还原真人在正常说话时候的唇部动作,脸部表情及微动作,对3D数字人模型进行实时驱动、渲染,使其面部肌肉驱动、表情肢体和语言表达能力达到一个较高的度契合。确保非专业人士无法分辨出是真人拍摄的视频还是通过数字技术合成出来的视频。

二、核心亮点: AI驱动、多模态交互

1.AI驱动的 3D数字人

远传科技“数字主持人”是一种由AI所驱动的虚拟存在,拥有和真人一致的音容、笑貌和言谈举止,拥有表达情感和智慧的能力。仔细观察会发现,3D AI合成主播是基于 AI算法实现驱动。

具体来说,3D“数字主持人”靠 AI算法实时驱动,输入一个文本就能输出一个视频,往往生成一个 1分钟的视频,仅只需要 1分钟,几乎可以看作实时生成。

2.关键技术赋能多模态交互创新

唇动算法、3D建模技术、深度学习算法、5G通信等关键技术探索文本、语音和视觉多模态交互创新的无限可能。

远传科技利用唇动算法分析出数字人应显示的口型标记,突破语言交流过程的表情和唇动的无缝链接;根据给定人物形象要求,建立数字人3D模型,绑定骨骼,创立动作动画和口型动画;基于深度学习算法、肢体捕捉技术,将文本、音频和图片实时生成数字人视频;5G通信技术则让用户跟数字人进行语音视频互动成为可能,麦克风和摄像头捕捉用户的语音和动作,数字人的后端人工智能算法根据场景生成对应的数字人交互动作、表情和语音。

三、未来已来,准备好了吗?

远传科技“数字主持人”虽然基于真实的人进行建模,但呈现在人们面前的行为都是完全逼真的,能像真实主播一样,去笑,去哭,去表达,是被创造出来的一个“数字人”。

数字人的未来将会作为主体人的一个副本形式存在于数字世界中,在未来的数字世界中将无法分辨出真人和数字人,大量在数字世界的服务将都会由数字人来代替,在电话客户服务、线上产品讲解、电商直播甚至线上演唱会等众多场景都将会有数字人的角色参与,数字化终极未来也许就是数字人的世界。