大型语言模型 (LLM) 是处理人类语言的深度学习模型的最新进展。法学硕士的一些很好的用例已经得到证明。大型语言模型是经过训练的深度学习模型,可以像人类一样理解和生成文本。在幕后,这是一个发挥所有魔力的大型变压器模型。

在这篇文章中,您将了解大型语言模型的结构及其工作原理。特别是,您会知道:

- 什么是变压器型号

- 变压器模型如何读取文本并生成输出

- 大型语言模型如何以类似人类的方式生成文本。

概述

这篇文章分为三个部分;他们是:

- 从 Transformer 模型到大型语言模型

- 为什么 Transformer 可以预测文本?

- 大型语言模型是如何构建的?

从 Transformer 模型到大型语言模型

作为人类,我们将文本视为单词的集合。句子是单词的序列。文档是章节、章节和段落的序列。然而,对于计算机来说,文本仅仅是字符序列。为了使机器能够理解文本,可以构建基于循环神经网络的模型。该模型一次处理一个单词或一个字符,并在整个输入文本被消耗后提供输出。这个模型运行得很好,只是它有时会在到达序列末尾时“忘记”序列开头发生的事情。

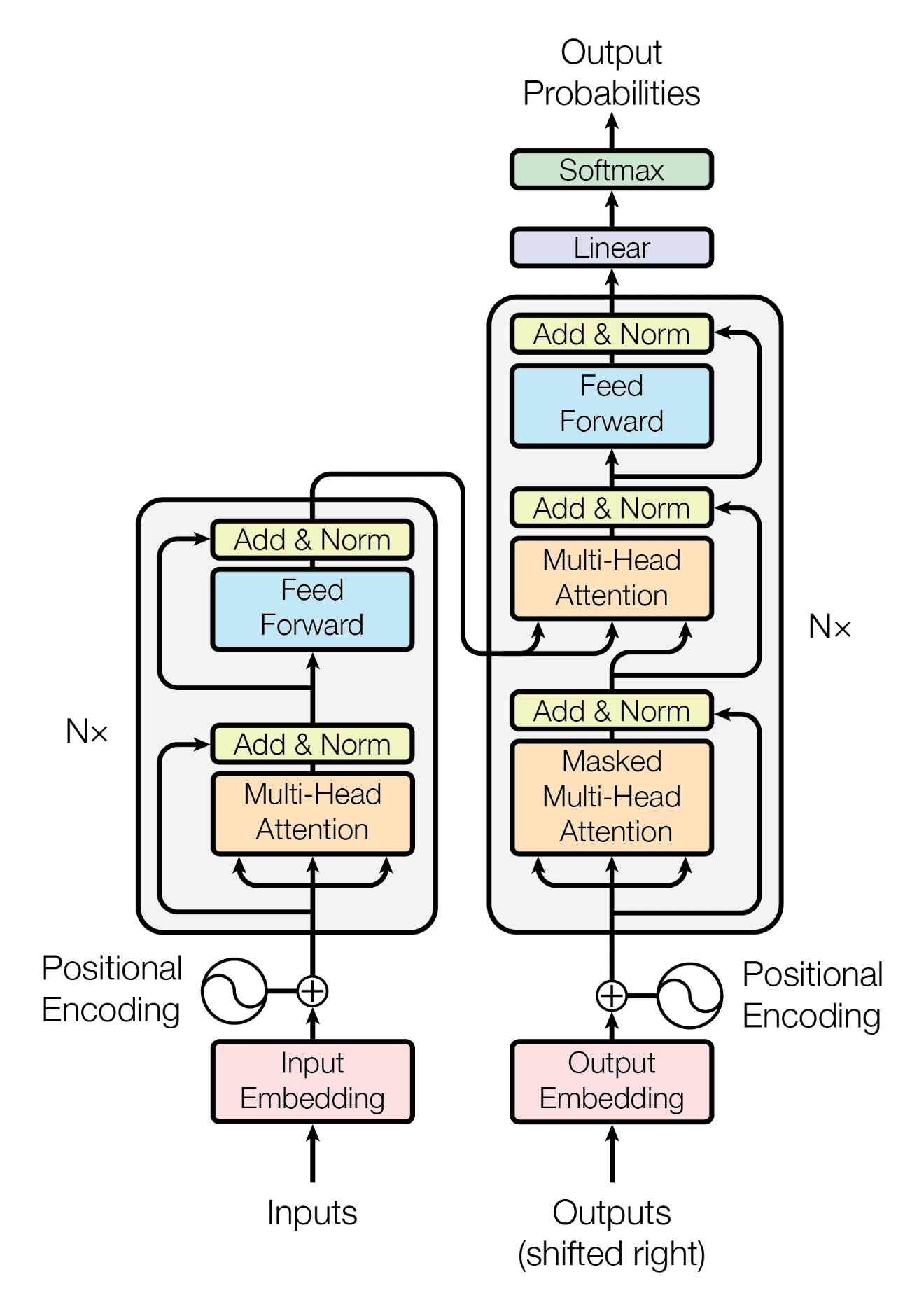

2017 年,Vaswani 等人。发表论文《Attention is All You Need》建立Transformer 模型。它是基于注意力机制的。与循环神经网络相反,注意力机制允许您一次看到整个句子(甚至段落),而不是一次看到一个单词。这使得转换器模型能够更好地理解单词的上下文。许多最先进的语言处理模型都是基于 Transformer 的。

要使用转换器模型处理文本输入,首先需要将其标记为单词序列。然后,这些标记被编码为数字并转换为嵌入,这是保留其含义的标记的向量空间表示。接下来,转换器中的编码器将所有标记的嵌入转换为上下文向量。

下面是一个文本字符串、其标记化和向量嵌入的示例。请注意,标记化可以是子词,例如文本中的单词“nosegay”被标记为“nose”和“gay”。

|

1

|

As she said this, she looked down at her hands, and was surprised to find that she had put on one of the rabbit’s little gloves while she was talking. “How can I have done that?” thought she, “I must be growing small again.” She got up and went to the table to measure herself by it, and found that, as nearly as she could guess, she was now about two feet high, and was going on shrinking rapidly: soon she found out that the reason of it was the nosegay she held in her hand: she dropped it hastily, just in time to save herself from shrinking away altogether, and found that she was now only three inches high.

|

|

1

|

[‘As’, ‘ she’, ‘ said’, ‘ this’, ‘,’, ‘ she’, ‘ looked’, ‘ down’, ‘ at’, ‘ her’, ‘ hands’, ‘,’, ‘ and’, ‘ was’, ‘ surprised’, ‘ to’, ‘ find’, ‘ that’, ‘ she’, ‘ had’, ‘ put’, ‘ on’, ‘ one’, ‘ of’, ‘ the’, ‘ rabbit’, “‘s”, ‘ little’, ‘ gloves’, ‘ while’, ‘ she’, ‘ was’, ‘ talking’, ‘.’, ‘ “‘, ‘How’, ‘ can’, ‘ I’, ‘ have’, ‘ done’, ‘ that’, ‘?”‘, ‘ thought’, ‘ she’, ‘,’, ‘ “‘, ‘I’, ‘ must’, ‘ be’, ‘ growing’, ‘ small’, ‘ again’, ‘.”‘, ‘ She’, ‘ got’, ‘ up’, ‘ and’, ‘ went’, ‘ to’, ‘ the’, ‘ table’, ‘ to’, ‘ measure’, ‘ herself’, ‘ by’, ‘ it’, ‘,’, ‘ and’, ‘ found’, ‘ that’, ‘,’, ‘ as’, ‘ nearly’, ‘ as’, ‘ she’, ‘ could’, ‘ guess’, ‘,’, ‘ she’, ‘ was’, ‘ now’, ‘ about’, ‘ two’, ‘ feet’, ‘ high’, ‘,’, ‘ and’, ‘ was’, ‘ going’, ‘ on’, ‘ shrinking’, ‘ rapidly’, ‘:’, ‘ soon’, ‘ she’, ‘ found’, ‘ out’, ‘ that’, ‘ the’, ‘ reason’, ‘ of’, ‘ it’, ‘ was’, ‘ the’, ‘ nose’, ‘gay’, ‘ she’, ‘ held’, ‘ in’, ‘ her’, ‘ hand’, ‘:’, ‘ she’, ‘ dropped’, ‘ it’, ‘ hastily’, ‘,’, ‘ just’, ‘ in’, ‘ time’, ‘ to’, ‘ save’, ‘ herself’, ‘ from’, ‘ shrinking’, ‘ away’, ‘ altogether’, ‘,’, ‘ and’, ‘ found’, ‘ that’, ‘ she’, ‘ was’, ‘ now’, ‘ only’, ‘ three’, ‘ inches’, ‘ high’, ‘.’]

|

Embedding of the Above Text

|

1

2

3

4

5

|

[ 2.49 0.22 -0.36 -1.55 0.22 -2.45 2.65 -1.6 -0.14 2.26

-1.26 -0.61 -0.61 -1.89 -1.87 -0.16 3.34 -2.67 0.42 -1.71

…

2.91 -0.77 0.13 -0.24 0.63 -0.26 2.47 -1.22 -1.67 1.63

1.13 0.03 -0.68 0.8 1.88 3.05 -0.82 0.09 0.48 0.33]

|

上下文向量就像整个输入的本质。使用这个向量,变压器解码器根据线索生成输出。例如,您可以提供原始输入作为线索,并让转换器解码器生成自然跟随的后续单词。然后,您可以重复使用相同的解码器,但这次线索将是先前生成的下一个单词。可以重复此过程以从前导句子开始创建整个段落。

变压器架构

这个过程称为自回归生成。这就是大型语言模型的工作原理,除了这样的模型是一个转换器模型,可以接受很长的输入文本,上下文向量很大,因此它可以处理非常复杂的概念,并且其编码器和解码器中有很多层。

为什么 Transformer 可以预测文本?

Andrej Karpathy在他的博客文章“循环神经网络的不合理有效性”中证明了循环神经网络可以相当好地预测文本的下一个单词。不仅因为人类语言(即语法)中存在限制单词在句子中不同位置使用的规则,而且还因为语言中存在冗余。

根据克劳德·香农(Claude Shannon)颇具影响力的论文“印刷英语的预测和熵”,尽管英语有 27 个字母(包括空格),但每个字母的熵为 2.1 位。如果随机使用字母,熵将为 4.8 位,从而更容易预测人类语言文本中接下来的内容。机器学习模型,尤其是 Transformer 模型,擅长做出此类预测。

通过重复这个过程,变压器模型可以逐字生成整个段落。然而,变压器模型所看到的语法是什么?本质上,语法表示单词在语言中的使用方式,将它们分类为不同的词类,并要求句子中的特定顺序。尽管如此,列举所有语法规则仍然具有挑战性。实际上,Transformer 模型并不显式存储这些规则,而是通过示例隐式获取它们。该模型可能不仅可以学习语法规则,还可以扩展到这些示例中提出的想法,但变压器模型必须足够大。

大型语言模型是如何构建的?

大型语言模型是大规模的转换器模型。它太大了,通常无法在一台计算机上运行。因此,它自然是通过 API 或 Web 界面提供的服务。正如您所料,如此大的模型是从大量文本中学习的,然后才能记住语言的模式和结构。

例如,支持 ChatGPT 服务的 GPT-3 模型是根据来自互联网的大量文本数据进行训练的。这包括书籍、文章、网站和各种其他来源。在训练过程中,模型学习单词、短语和句子之间的统计关系,使其能够在给出提示或查询时生成连贯且上下文相关的响应。

因此,从大量文本中提取的 GPT-3 模型可以理解多种语言并掌握各种主题的知识。这就是为什么它可以生成不同风格的文本。虽然您可能会惊讶于大型语言模型可以执行翻译、文本摘要和问题回答,但如果您认为这些是与引导文本(又名提示)匹配的特殊“语法”,则不会感到惊讶。