引言

经验表明,网络热门话题随着时间迅速消逝,快的一个星期,慢的一个月。然而,小半年过去了,浪潮并未停歇,还在不断往前推进,愈演愈烈。。。时代浪潮下的小海燕,该怎么办?是继续懵懂的等着大浪拍过来,生死由天,还是未雨绸缪,提前起飞,御浪而行?

广阔无垠的海面上,一群海鸟在叽叽喳喳:

(1)海燕与海鸥在惬意交谈,一个小浪花拍过来,也只是扑腾几下翅膀,保持平衡后,继续乐不思蜀,没注意到水下暗流涌动,一场巨浪即将袭来。

(2)而身后的三只海燕未卜先知,早已察觉异常,提前起飞,不但能躲过这场灾难,还能坐收渔翁之利,趁乱捕食晕头转向的鱼群。

此情此景,让人联想到教员的一首词:《浪淘沙-北戴河》

大雨落幽燕,白浪滔天,秦皇岛外打鱼船。

一片汪洋都不见,知向谁边。

海浪来临之际,你是前面的慢性子,还是后面的先行者?

如《漫谈(提示工程)与CoT(思维链)》所说:人的认知总是偏离事实。

面对这个充满不确定性的世界,过度恐惧让人胆怯、保守,过度乐观让人愚昧、自大。

1 开疆拓土

自从GPT-4发布后,各方继续探索、GPT-4原理、用法,每周进展层出不穷。

(1)2023年3月17日,正式发布,适用于 Word 、 、 Excel 、 等,微软新版全家桶诞生,功能强悍。由于另外收费,真正使用的人并不多。

(2)2023年3月20日左右,一款使用GPT-4的代码编辑软件发布。使用简单,只需用两个快捷键:Ctrl+K和Ctrl+L,就可以启动代码生成、聊天、校验等。这款免费软件发布没多久,迅速走红,大家蜂拥而至,服务开始响应超时,不得不从GPT-4退化到GPT-3.5,直至免费策略取消,开始收费。详见:《程序猿的恐慌时刻:智能代码编辑器体验》

(3)2023年3月22日, GPT诞生,直接通过文本生成动作,驱动3D模型。

(4)2023年3月24日,宣布解除无法联网的限制,以第三方插件为桥梁,让访问其他网站并获取实时信息,还支持执行计算。这样具备执行能力,有了“眼睛和耳朵”。更重要的是,的众多第三方插件成为聊天版“App Store”,想象空间很大。

短短几条新闻,已经出现了几次GPT,有的还有-3.5和-4,各路资讯频繁出现的GPT称呼五花十色,让人傻傻分不清。

这些GPT称呼到底是什么呢?回顾另一篇文章《:从入门到入行(放弃)》就能找到答案。

各种GPT的演进关系:

GPT-N表示GPT模型的几个正式版本,如 GPT-1、GPT-2、GPT-3,还有GPT-3.5(即 GPT),是大语言模型(LLM)的官方版本,当然还有3月15日发布的GPT-4,模态从语言扩展到图像。

而是GPT-3.5衍生出来的一个应用版本,不是正式版本。所以,GPT-3.5和是两个维度的事情。

那媒体提的-3.5和-4是怎么回事儿?严格意义上,这两个术语术语是媒体无意中“捏造”的,分别对应官方GPT应用:和GPT-4。

GPT的称呼还有很多旁路。

如GPT-2系列发展而来的和,纯粹是个人(大神 )为了将稳重、昂贵的GPT-3民用化而做出的努力。

而Codex、Text-*等,是另一个划分维度:官方API可调用的GPT模型名,具体如下:

Codex表示GPT-3在代码数据集上训练的模型版本

表示GPT-3在人工指令集上通过基于人工反馈的强化学习(RLHF)训练后的版本。Code–002(达芬奇)将二者融合起来,博采众长。

Text–*:继续把Code–002应用于文本领域得到了Text–002

接着模型名开始分化:Text–003和两个亲兄弟

这下知道GPT系列各个版本的关系了吧?再也不用对着资讯里的五花八门的GPT称号瞪眼睛了,说不定还能“打假”。

Image GPT、 GPT等指的是应用领域。

在大家的不懈努力下,应用场景遍地开花,总结如下:

(1)首先,直接关联的业务是NLP基础任务(数据处理/标注/评估)、搜索(微软/谷歌/百度的地盘)、问答(智能助手不再智障,如文档问答有了难得的突破)、多模态等

(2)其次,个人提效,将已有应用重新做一遍,如:办公软件、编程软件、平面设计,甚至3D建模

(3)接着,进一步渗透到物联网、智能家居,乃至机器人。几个问题需要一一解决

第一,提供第三方插件市场(相当于app应用市场),形成生态——已发布插件市场

第二,让语言模型自动选择并执行合适的API,而且具有普适性——微软的自动适配api

第三,具备行动能力,光有大脑没有躯干,就只是空想——投资人行机器人公司

提几个典型应用

(1) 365

由的GPT-4驱动的,嵌入到 365应用程序中,以聊天机器人出现在侧边栏(原本的位置)。

用户通过直接使用自然语言提出要求,来指挥 Teams、Word、Excel、、、等应用程序,体验过程更加主动、智能。

可以根据用户给出的提示,撰写、编辑文档,检查语法,调用其他应用中的素材,生成整个文档。

用户只需说出想法,就可以做出一个完整的PPT。如果用户想调整PPT内容、排版、配色等,只需要向发出指令,而不必去研究的具体功能。

直接根据Word内容生成一个图表,用户无需编写公式,只通过自然语言提示即可填充和搜索数据,即时创建基于数据的SWOT分析或数据透视表,找到数据的相关性,协助分析数据,得出趋势结论。

这一切都只需用户提供自然语言形式的指令,不用照着指南学习复杂的操作方法了。操作门槛下降,工作效率提升。

(2)编程软件

和,功能强悍:

(1)代码生成:按照指令生成10-100行代码

(2)代码聊天:选定部分代码,针对性聊天,检查代码Bug,执行代码等

(3)代码比对:提示哪里有变动,并突出显示

(4)代码完善:修复不符合lint代码规范的片段,生成测试用例、注释等

让程序心头一惊:自己写的程序开始反过来干掉自己了?

实际上只是辅助工具,还无法大规模替代,详见文章《程序猿的恐慌时刻:智能代码编辑器体验》

2GAI大展宏图

起步于语言理解的GPT,只是生成式AI里的一个模型,整个AIGC产业幅员辽阔,包含了文本、代码、语音、图像、视频、3D等方方面面。

红杉报告里的图解:上面是各个媒介上的应用场景,下面是典型模型、品牌,按照生成对象的媒介,AIGC模型又可细分为9大类:

: 、LaMDA、PEE、 From Brain

: Codex、

: DALL-E 2、 、、Muse

: 、、

: 、

: 、Magic 3D

: 、

: 、

生成式人工智能(GAI)带火AIGC产业,如文章《AIGC()怎么这么火?》所示,从文本到语音,到图像,再到视频,3D建模,动作等,让人不得不惊叹AIGC疆土如此辽阔!

(1)图像生成

是生成式人工智能( AI,简称GAI)的一种 ,同类AI还包括 DALL-E、 ,以及。

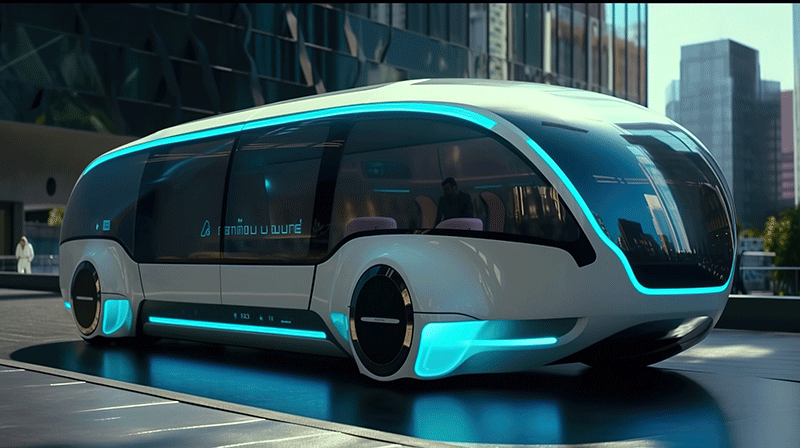

由于文心一格免费名额以耗尽,转而找生成本文的首图,细节满满。

提示语():a on the left stay on the water, while to fly, a wave On the sea, heavy rain start

相比文心一格,页面简洁,右侧可设置图片大小,对比度。一次生成4张图,清晰度较高。

地址:

虽然支持多语种,其它语种效果没有英文好。如下图所示,上面一栏中文,试了几次,并未理解其中含义,一只海鸟都没有,还出现了莫名其妙的火山爆发;用翻译成英文后,效果好些,下面一栏出现了大海、海鸟。

作画时,用什么句子作为呢?新手并不好把握,试验的过程充满不确定性。有人利用创作能手生成推荐提示语,很快就画出了艺术感十足的水彩画。

(2)视频

画面再美也是静态,能不能动起来?以文心一格的一张古装女子作品为例,使用工具将图片转成视频,同时按照输入的文本播放指定风格的声音。

比如,让她朗读李清照的《如梦令》,根据文字内容驱动脸部表情,头部动作。

视频:《AIGC诗词朗诵:如梦令》,使用D-ID制作。

自媒体里早起的鸟儿已经开始用起来了。

(3)3D建模

既然文本能驱动面部表情,那动作也可以吧?当然,黄教主在发布会上,展示一个足球比赛视频3D化的效果图:

视频地址:

文本生成动作,在娱乐、虚拟现实和机器人等领域都有大量应用。

2022年10月推出的TEACH,无需剪辑或编辑,只需按顺序输入几条命令,3D人物就能自动完成每一套动作,全程丝滑无bug。

2023年3月推出的另一款杰作是 GPT。利用GPT-3实现任意文本动作生成。

算法原理图解:

详见:

(4)元宇宙

图像、语音、视频、动作等都有了,炒了几年确迟迟不见踪影的元宇宙不就来了吗?

D-ID虽强,但只是驱动图片上半身表情、动作,有没有个更完整的?

百度布局较早,小度屏中内置数字人助理,唤醒小度屏后与用户进行交流互动,重点应用于儿童及老人陪伴等居家场景

智能数字人平台:曦灵,支持导入已有 3D/2D 模型

通过三种驱动模式:AI 驱动、拟合驱动和真人驱动,既能直接用 AI 智能驱动,也能用真人在背后进行“中之人”演绎。

以上是宣传效果,企业用户才能使用。个人用户怎么体验?

腾讯智影,小程序、APP可访问,虚拟人配音,可自由体验,让数字人帮你出境、讲解,自媒体人的福音。

闭关修炼

眼花缭乱之余,静下来,回到AI的初心:创造类人智能。

人类(或动物)是怎么感知周围世界信息的?

神经系统接收和处理外界信息,作出反应、进行通信并确保身体的健康与安全。

环境信息传递到感觉器官:眼睛、耳朵、鼻子、舌头和皮肤。细胞和组织接收原始刺激,并将其转化为神经系统可以使用的信号。

神经将信号传递到大脑,大脑将其解释为影像(视觉)、声音(听觉)、气味(嗅觉)、味道(味觉)和触感(触觉)。

而计算机是对大脑的降维模拟,计算机视觉课程里时常提到的一张图:

摄像头充当了眼睛,承担视觉信息捕获——计算机视觉

麦克风充当了耳朵,获取环境声音——语音识别和语音合成

鼠标、触摸板或其它触觉传感器,充当了皮肤,感知动作信息——人机交互

有些软体机器人具备触觉、嗅觉、味觉、重力等——传感器领域

而电脑主机(CPU、GPU、TPU这类计算单元)充当了最重要的大脑,分析环境信息,做出反应。—— 计算机体系结构

系列出来前,这个大脑的语言理解能力有限,导致手机助手、智能音箱、扫地机器人等智能设备笑话频出,人工智能被戏称“人工智障”,工业落地时,有多少智能就有多少人工。

系列出来后,大幅提升了语言理解能力,让人耳目一新,困扰NLP几十年的语言理解能力突飞猛进。

详见文章:《:从入门到入行(放弃)》里的对话系统部分。

GPT系列的快速进化,让计算机大脑从2-3岁婴儿成长为6-9岁小孩儿。

3月22日,微软发布了154页长篇大论,介绍GPT-4早期实验成果以及不可思议的神奇之处。

of : Early -4

除了语言理解,GPT-4还可以解决跨越数学、编码、视觉、医学、法律、心理学等新颖、困难的任务,而不需要任何特别提示,惊人地接近人类的表现,而且大大超过之前的模型,如。

当然,也有局限:会编造内容、会继承一些训练模型中的偏见等。

鉴于GPT-4能力的广度和深度,可以视为人工通用智能(AGI)系统的早期版本(但仍不完整)。

尽管各方拼命追赶,仍然遥遥领先,但并不满足。

3月23日,投资挪威人形机器人公司1X,加大力度研发双足机器人模型NEO,以及在挪威和北美量产其首款商用机器人EVE。

如果成功落地,那GPT系列除了超强“大脑”,又有了强健的身体,如虎添翼。试想下类似动力的机器人出现在你面前,既能听懂你的指令,还能帮你干活,陪你聊天。到时候,人形机器人管家就正式从电影(Her)走入了现实生活。

4GAI行业变局

GAI如此强悍,大家难免有些恐慌:我的工作会被取代吗?

比尔·盖茨表示,可以对用户查询做出惊人的类似人类的反应,与互联网的发明一样重要:

“到目前为止,人工智能可以读写,但无法理解内容。像这样的新程序将通过帮助写发票或信件来提高许多办公室工作的效率,这将改变我们的世界”。

“这与个人电脑、互联网一样重要,成为2023年最热门的话题”。

3月28日,高盛( Sachs)在最新研究报告(The Large of on )中提到:

等生成式AI将给全球劳动力市场带来巨大影响,10年内将全球GDP提高7%,但也将给劳动力市场带来“重大颠覆”。

全球预计将有3亿个工作岗位被生成式AI取代,而律师和行政人员将是最有可能被裁员的岗位。

外媒盘点:最可能被 取代 10 大高危职位:

技术工种(程序员、软件工程师、数据分析师)

媒体工作者(广告、内容创作、记者)

法律行业工作者(律师助力、法律助理)

市场研究分析师

教师

财务(财务分析师, 个人财务顾问)

交易员

平面设计师

会计师

客服

总之, 最容易取代那些重复性、单调、简单的任务,而对于需要创造力、判断力和情感理解的领域,仍需要人类参与。

其实,这个话题在2012年AI第三次兴起时,就广为热议。

前研究团队负责人Jeff Clune预测,30%的工作在2030年借助AGI(通用AI)实现50%的人类工作自动化。基于聊天的人工智能可以通过自动化重复任务来增强人类的工作方式,同时提供与用户更具吸引力的交互。

麦肯锡预测:2030年,中国将有至少1.18亿人的岗位被机器人取代。

这要求他们学习新技能,适应与机器人的合作分工;

其中700~1200万人需要转换职业。

可能会受到波及的行业:

1、凡涉及到标准化、流程化、人力或管理成本高的领域,都将全面数字化、机器人化与智能化,需要人的岗位就是操作员,甚至仅作为系统风控备份设置,先进制造业产业工人的知识门槛会提高,窗口型、服务型的大部分岗位将以机器人为主,比如客服。

2、在各行业的研发领域,AI也将取代大部分基础岗位。

3、岗位没有了,管人的职务自然也会大幅度减少,传统企业管理更多在强调“团队”,新一代企业却会更扁平化。

4、文化娱乐行业将被改写。在内容生产领域(文案、海报、视频直播、音乐、动漫、游戏等),人工智能无论原创还是二创,都会比大多数从业者干的更出色,哪怕是顶尖的人士也会采用AI辅助设计。

李开复直接列出了20个容易被AI取代的工作。

最危险TOP10种工作

1、电话营销员/电话销售

2、客户服务

3、仓库工人

4、出纳和运营人员

5、电话接线员

6、出纳员/收银员

7、快餐店员

8、洗碗工

9、生产线质检员

10、快递员

“外强中干”工作TOP10(看上去金饭碗,其实危机四伏)

1、销售与市场研究

2、保险理赔员

3、保安人员

4、卡车司机

5、消费者贷款受理人

6、财经和体育记者

7、记账员与财务分析师

8、水果采摘者

9、专业投资人员

5 GAI迷途沉思

GPT系列还在飞速迭代,每隔几个月就有新的进展,而风险也与日俱增。大语言模型怎么突然就这么厉害了?学界也不清楚原因,提了个玄学名词:涌现能力,让人丈二和尚摸不着头脑。

以GPT为代表的GAI也是如此,让人欢喜让人忧。

3月29日,千位大佬的联名信:暂停超强AI训练六个月。

图灵三巨头中,一位带头签名,一位强烈反对,还有一位不发一言。

签名、沉默、LeCun反对

对于GPT系列的爆火,有疯狂崇拜,有人积极跟进,有人则冷眼相待。

举世皆浊我独清,众人皆醉我独醒。

这类勇敢的少数派敢公开唱反调,值得敬佩。

纽约大学教授马库斯赞同说

GPT-5不会是AGI。几乎可以肯定,GPT模型不是AGI。今天使用的方法(梯度下降)优化的任何模型完全不可能成为AGI。即将问世的GPT模型肯定会改变世界,但过度炒作是疯狂的。

2023年3月24日,图领奖获得者Yann LeCun 一贯犀利,直言不讳地指出:

「 sucks!」机器学习行不通

「Auto- Suck!」,自回归语言模型GPT系列也行不通,包括、GPT-4,离真正的AGI还很远。

GPT-4并未达到人类智能,年轻人花20h练车就掌握了开车技能,即便有专业司机的海量训练数据、高级传感器的辅助,L5级别自动驾驶到现在还没实现

GPT这类自回归模型有天生缺陷,无法兼顾事实、不可控:

序列化生成过程将问题解空间一步步缩小,陷入局部深井,错误指数级别累积。

语出惊人,颇有一股侠者风范。

除了GPT,他还给机器学习几乎所有方向判了死刑。想用监督学习、强化学习和自监督学习实现AGI?不可能。

与人、动物相比,机器学习

(1)监督学习需要大量标注样本

(2)强化学习需要大量试错样本

(3)自监督学习需要大量非标注样本

而当前大部分基于机器学习的AI系统常常出现愚蠢错误,不会推理、规划

反观,动物或人:

(1)快速学习新任务

(2)理解环境运行逻辑

(3)推理、规划

人和动物具备常识,而机器表现得很肤浅

那么,AGI出路在哪儿?「世界模型」

构建一个能够进行推理和规划的认知架构。这个架构由 6 个独立的模块组成:

(1)配置器()模块;

(2)感知模块( );

(3)世界模型(World model);

(4)成本模块(Cost );

(5)actor 模块;

(6)短期记忆模块(Short-term )。

详见:《A path 》

因此,当前的生成式AI尽管出尽风头,但还只是刚步入AGI的门槛,并未真正站稳…

6 AGI任重道远

几年前朱松纯讲过《一只乌鸦给我们的启示》:体型大小都差不多的乌鸦和鹦鹉。

鹦鹉有很强的语言模仿能力,一个短句,多说几遍,它就能重复,类似于当前的由数据驱动的聊天机器人。

鹦鹉和聊天机器人都能说话,但都不明白语境和语义,不能把说的话对应到物理世界和社会的物体、场景、人物,不符合因果与逻辑。

而乌鸦远比鹦鹉聪明,不仅会制造工具,还懂得各种物理的常识和人的活动的社会常识。

研究人员在日本发现一只野生乌鸦,没人管,没人教。靠自己观察、感知、认知、学习、推理、执行,完全自主生活。

乌鸦面临第一个任务是寻找食物。

找到坚果还不能吃,需要砸碎,可是这个任务超出它的物理动作的能力。其它动物(如大猩猩)会使用工具,找几块石头,一块大的垫在底下,一块中等的拿在手上来砸。

乌鸦怎么试都不行,它把坚果从天上往下抛,发现解决不了这个任务。这个过程中,发现一个诀窍:把果子放到路上让车轧过去(图b),“鸟机交互”。

后来进一步发现,虽然坚果被轧碎了,但到路中间去吃很危险。车水马龙路,随时就game over了。

这个过程没有大数据训练,也没有所谓监督学习,乌鸦的生命没有第二次机会。

所以说,监督学习和强化学习都行不通。

然后,它又开始观察了,图c。发现在靠近红绿灯的路口,车子和人有时候停下了。这时必须领悟出红绿灯、斑马线、行人指示灯、车子停、人流停这之间复杂的因果链。甚至,哪个灯在哪个方向管用、对什么对象管用。

搞清楚之后,乌鸦就选择了一根正好在斑马线上方的一根电线蹲下来(图d)。也许它观察和学习的是别的地点,没有这些蹲点的条件。它必须相信,同样的因果关系可以迁移当前的地点。

当前很多机器学习方法是做不到。比如

一些增强学习方法,让机器人抓取一些固定物体,如积木玩具,换一换位置都不行;

打游戏的人工智能算法,换一换画面,又得重新开始学习。

它把坚果抛到斑马线上,等车子轧过去,然后等到行人灯亮了(图e)。这时车子都停在斑马线外面,它终于可以从容不迫地走过去,吃到了地上的果肉。

乌鸦多聪明,这才是真正的智能。

乌鸦给我们的启示:

其一、完全自主的智能。感知、认知、推理、学习和执行。世界上一批顶级的科学家都解决不了的问题,乌鸦向我们证明了这个解存在。

其二、大数据非必须。乌鸦有几百万人工标注好的训练数据给它学习吗?没有,它自己把这个事通过少量数据想清楚了,没人教它。

其三、海量计算非必须。乌鸦头有多大?不到人脑的1%大小。人脑功耗大约是10-25瓦,乌鸦只有0.1-0.2瓦,根本不需要核动力发电。这给硬件芯片设计者提出了挑战和思路。

这个解存在,但目前还不知道怎么实现这。我们要寻找“乌鸦”模式的智能,而不是“鹦鹉”模式的智能。当然,不能否认,“鹦鹉”模式的智能在某些垂直应用有效。

AI研究者应该寻求乌鸦智能,而不是鹦鹉智能。